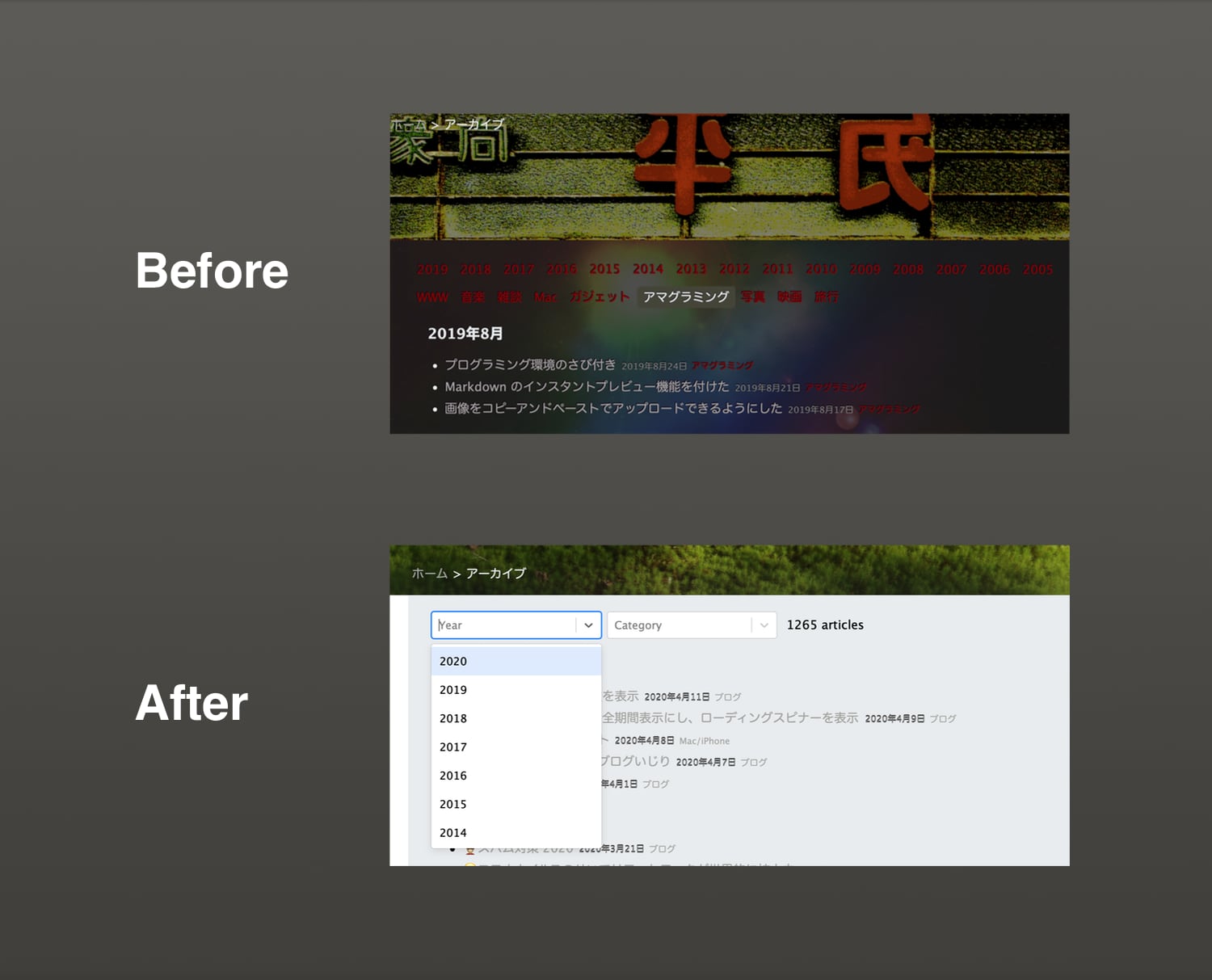

最近、ブログに Amazon アソシエイトの広告が表示されなくなっていた。記事の新規公開時だけでなく、最新の価格情報を取得するため 24 時間のみキャッシュして都度新しいデータをとるようにしていたが、商品が 30 日間売れなかったため API へのアクセス権を剥奪されてしまったようだ。アフィリエイト報酬がもらえないのもさみしいが、それよりも記事に商品の画像を表示出来ないのが悲しい。結構頑張って仕組みを作ったのに。

ドキュメントには以下のように書いてあった。

Note that your account will lose access to Product Advertising API 5.0 if it has not generated referring sales for a consecutive 30-day period.

これはかなりきびしい。 30 日間でものが売れないことなんてザラにある。 ものが売れない -> API のアクセス権剥奪 -> 商品情報取得できない -> ものが売れない の負のスパイラルに陥ってしまうので基本的には抜け出すことはできない。

Google Adsense といい、個人の泡沫ブログで小銭を稼ぐのがどんどん難しくなっていく。